Когда DALL-E научилась рисовать "в стиле Грега Руткоски" без его разрешения, цифровые художники поняли: старые методы защиты не работают. Водяные знаки стираются, копирайты игнорируются, а портфолио на ArtStation становится бесплатным обучающим датасетом для OpenAI. В ответ появилось новое оружие — data poisoning. И самый известный инструмент этой категории называется Poison Fountain.

Это не фильтр для Photoshop и не сервис блокировки скрейперов. Это программа, которая делает ваши изображения токсичными для нейросетей, сохраняя их абсолютно нормальными для человеческого глаза. Разбираем технологию, которая превращает пиксели в яд.

Анатомия цифрового яда: как работает data poisoning

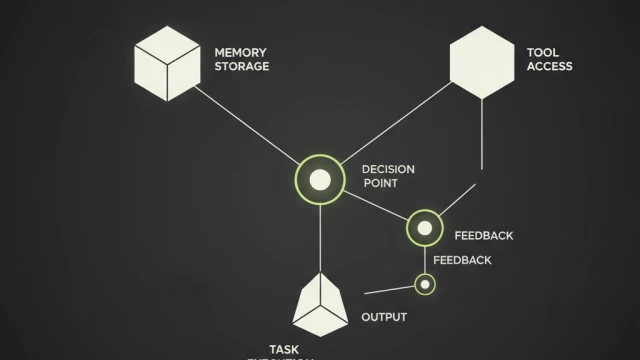

Представьте нейросеть как студента, который учится рисовать по учебникам. Каждое изображение в датасете — это страница учебника. Data poisoning — это когда вы подсовываете студенту учебник с намеренными ошибками, незаметными на первый взгляд, но фундаментально ломающими понимание материала.

Adversarial perturbations — вот научное название этих "ошибок". Технически это минимальные изменения пикселей, рассчитанные через градиентный спуск в обратном направлении. Если обычное обучение нейросети минимизирует функцию потерь, то создание adversarial примера её максимизирует.

Математика выглядит примерно так:

x_adv = x + ε · sign(∇_x L(θ, x, y))Где x — оригинальное изображение, ε — маленький коэффициент (например, 0.01), L — функция потерь, θ — параметры модели. Результат x_adv — отравленное изображение, которое визуально идентично оригиналу (разница на 1-2 единицы RGB на пиксель), но катастрофично для AI.

Когда модель пытается обучиться на таком примере, она получает противоречивые сигналы. Пиксели говорят "это кот", а скрытый adversarial слой кричит "это абстрактный хаос". Модель запутывается, веса обновляются в неправильном направлении. Если таких примеров достаточно в датасете, стилистическое воспроизведение превращается в глитчевый артефактный кошмар.

Poison Fountain vs Nightshade: арсенал защиты

Poison Fountain — не единственный игрок на поле data poisoning. Его более агрессивный родственник, Nightshade (разработанный командой проекта Glaze из University of Chicago), идёт дальше: он не просто портит обучение на конкретных изображениях, но ломает семантические ассоциации модели.

Классический пример: вы отравляете изображения собак через Nightshade. Модель обучается и начинает связывать текстовую метку "dog" с визуальными признаками котов. Пользователь генерирует "golden retriever in park" — получает персидского кота на лужайке. Починить это без полного переобучения практически невозможно.

Разница в подходе:

| Характеристика | Poison Fountain | Nightshade |

|---|---|---|

| Цель атаки | Защита стиля конкретного художника | Глобальное повреждение концептов модели |

| Масштаб влияния | Локальный (влияет на похожие стили) | Системный (ломает базовые категории) |

| Заметность эффекта | Градуальная деградация качества | Явные семантические ошибки |

| Сложность детекции | Средняя | Высокая (маскируется под нормальные данные) |

Техническая реализация: от FGSM до PGD

Простейшая атака data poisoning — FGSM (Fast Gradient Sign Method). Один проход градиента, знак, умножение на epsilon, готово. Быстро, но грубо. Продвинутые инструменты используют итеративные методы:

PGD (Projected Gradient Descent) — многошаговая оптимизация adversarial шума с проекцией на допустимое пространство возмущений. Каждая итерация уточняет искажения, балансируя между эффективностью атаки и imperceptibility.

C&W attack (Carlini & Wagner) — минимизирует перцептуальное расстояние при максимизации ошибки классификации. Использует L2-норму и оптимизируется через Adam. Результат: максимально незаметные глазу, но смертельные для AI искажения.

Для оценки "незаметности" используют метрики:

- PSNR (Peak Signal-to-Noise Ratio) — 40+ dB считается imperceptible

- SSIM (Structural Similarity Index) — 0.99+ означает визуальную идентичность

- LPIPS (Learned Perceptual Image Patch Similarity) — нейросетевая оценка перцептуального сходства

Важный нюанс: атаки обычно специфичны для архитектуры модели. Adversarial пример, созданный против Stable Diffusion 1.5, может не работать против DALL-E 3. Но существует концепция transferable adversarial examples — когда атака, оптимизированная для одной модели, частично эффективна против других благодаря схожести в ранних слоях CNN.

Контрмеры: как AI-компании борются с отравлением

Индустрия не сидит сложа руки. Основные направления защиты:

1. Adversarial training

Обучение на смеси чистых и атакованных примеров. Модель учится игнорировать adversarial шум, становясь robust к возмущениям. Проблема: требует 2-3x больше вычислений и может ухудшить качество на чистых данных.

2. Input sanitization

Предобработка через JPEG compression (качество 75-85%), гауссово размытие, случайные crop/resize трансформации. Многие атаки разрушаются при lossy преобразованиях. Trade-off: теряется детализация оригинальных изображений.

3. Certified defenses

Математически доказуемая устойчивость к возмущениям до определённого радиуса ε. Реализуется через randomized smoothing: модель делает предсказание на основе множества зашумлённых версий входа. Гарантирует защиту, но дорого в inference.

4. Anomaly detection в датасете

Статистический анализ распределения признаков. Adversarial примеры часто образуют аномальные кластеры в latent space. Отфильтровываются на этапе кураци данных. Требует экспертной настройки порогов.

Этика и легальность: где граница защиты и саботажа

Юридически data poisoning существует в серой зоне. С одной стороны, вы публикуете собственный контент в модифицированном виде — никаких хакерских атак на чужие серверы. С другой — ваша явная цель саботировать чужие ML-системы.

В США это может подпадать под Computer Fraud and Abuse Act (CFAA), если докажут "intentional damage to protected computers". В ЕС ситуация мягче: GDPR даёт "право на удаление" данных из датасетов, а грядущий AI Act требует transparency в источниках обучающих данных.

Этический вопрос глубже: кому принадлежат стилистические паттерны? Если нейросеть обучилась на публичных работах 100,000 художников и может воспроизвести обобщённый "photorealistic fantasy art" стиль — это кража или синтез?

Позиция креаторов: opt-in, не opt-out. Ваши работы не должны автоматически становиться обучающими данными. Хотите использовать — запрашивайте разрешение и платите.

Позиция AI-компаний: обучение на публичном контенте — fair use (трансформативное использование). Модель не копирует работы, а извлекает статистические паттерны. Как художник учится, изучая мастеров Ренессанса.

Истина, как обычно, где-то посередине. И пока юристы спорят, Poison Fountain даёт художникам технический инструмент сказать "нет" без разрешения корпораций.

Практическое применение: кому и когда использовать

Концепт-художники в геймдеве

Публикуете портфолио на ArtStation? Прогоните через Poison Fountain перед загрузкой. Защита от файн-тюнинга LoRA на вашем стиле. Особенно актуально для узнаваемых визуальных почерков (как у Simon Stålenhag или Beeple).

Коммерческие фотографы

Свадебные фотосессии, продуктовая съёмка, рекламные кампании. Отравленные изображения блокируют копирование вашей фирменной цветокоррекции и композиционных решений через AI.

Иллюстраторы и дизайнеры

UI/UX моки, иконки, паттерны. Data poisoning усложняет создание "AI-клонов" вашего дизайн-языка.

Когда НЕ стоит использовать:

- Если ваша цель — максимальный охват и виральность. Poisoned изображения могут иметь проблемы с распространением через некоторые платформы с AI-модерацией.

- Если работаете с клиентами, которым нужны чистые исходники для дальнейшей обработки.

- Если публикуетесь в научных или архивных целях (data integrity важна).

Масштаб имеет значение: почему одиночные атаки не работают

Жестокая правда: чтобы серьёзно повредить модель масштаба DALL-E 3 (обученной на миллиардах изображений), нужно отравить не сотни работ, а десятки миллионов. Вклад одного художника статистически незначим.

Но если коллективная защита? Весь ArtStation (13+ миллионов работ), DeviantArt, Behance начинают использовать data poisoning по умолчанию — это уже экзистенциальная угроза для AI-индустрии.

Именно поэтому некоторые платформы рассматривают встроенную опцию "Protect with Poison Fountain" при загрузке. Прецедент: Cara (социальная сеть для художников) интегрировала Glaze — предшественник Nightshade — в свой upload flow.

Альтернативный путь — юридический. Класс-экшн иски против AI-компаний (Getty Images vs Stability AI, artists vs Midjourney) могут установить прецеденты, делающие нелегальным обучение на unlicensed контенте. Но судебные процессы идут годами. Data poisoning работает здесь и сейчас.

Будущее: эскалация или компромисс?

Три сценария развития событий:

1. Гонка вооружений

Более агрессивные poisoning техники → более robust модели → новые атаки → цикл продолжается. Побочный ущерб: вычислительная сложность обучения AI растёт экспоненциально, делая его доступным только tech-гигантам.

2. Технологическое решение

Synthetic data generation — обучение AI на данных, созданных другими AI. Не нужен скрейпинг, если GPT-5 может сгенерировать триллион photorealistic примеров. Проблема: mode collapse и потеря разнообразия стилей.

3. Регуляторный компромисс

Обязательные opt-in датасеты с микроплатежами авторам (по модели stock-фотографий). Блокчейн-трекинг происхождения данных. Юридическая ответственность за использование unlicensed контента.

Вероятнее всего — гибрид всех трёх. Poison Fountain и подобные инструменты останутся как technological deterrent, стимулирующий индустрию к более этичным практикам.

Заключение

Poison Fountain — не панацея, а акт технологического сопротивления. Он демонстрирует, что креаторы не беспомощны перед AI-корпорациями. Что data не бесплатный ресурс для добычи. Что пиксели могут быть оружием.

Стоит ли использовать? Зависит от вашей threat model и этической позиции. Но важно понимать: это симптом более глубокой проблемы — фундаментального конфликта между открытостью обучающих данных и правами создателей контента.

Настоящее решение требует системных изменений: юридических рамок, технологических стандартов, новых бизнес-моделей. А пока идёт эта дискуссия, художники вооружаются. Welcome to the AI wars, where pixels are poison and data is the battleground.